EUに拠点はないのに、なぜ“EUのAI法”が私たちの会社に関係あるの?

最近、社内や取引先からこんな声を聞くことが増えていませんか?

- 「うちのAIって、EU AI法の対象になるのかな…?」

- 「AIを使ったら罰則があるって本当…?」

- 「ChatGPTやCopilotを業務で使ってるけど、何かルールが必要?」

- 「経営から“EU向けに説明できる資料、まとめてくれ”と言われた」

多くの担当者が抱えるこの“モヤモヤ”には理由があります。

EU AI法(EU AI Act)は、世界初の包括的AI規制であり、GDPRと同じようにEU域外の企業にも影響し得ると言われています。

とはいえ、条文は膨大で、技術的な言葉も多く、「結局うちは何をすればいいの?」と立ち止まってしまうのがごく普通の反応です。

そこで本記事では、2026〜2027年に起こる重要ポイントを“整理して理解できる”ことを目的にしています。

- EU AI法の全体像

- 2027年までの段階的な適用の流れ

- レガシーAIの“2027年8月”デッドライン

- GPAI(汎用目的AI)・基盤モデルの義務

- 中小企業・スタートアップが“まずやるべき”最小ステップ

- 教育義務(Article 4)と社内AIリテラシー

- 最新動向(延期案・Digital Omnibus・行動規範)

こうした要素を、難しい法律の“解説”ではなく、実務担当者の“行動”につながる形でまとめました。

まずは全体像を知るだけで、“今すぐ必要なこと”と“2027年までの猶予があること”が自然と整理されていきます。

なお本記事は 最新の一次情報に基づく“情報提供”であり、個別の法的助言ではありません。

必要に応じて、専門家や最新の公式ドキュメントの確認を推奨します。

- はじめに:こんな不安、ありませんか?

- なぜ今「EU AI法」が話題なのか

- この記事の前提・参照元

- EU AI法(AI Act)の全体像を3分で掴む

- 2024〜2027年:フェーズ別タイムラインと検討のヒント

- うちは対象なの? チェックポイント

- 自社のAIを棚卸しする:AIマッピングシートと実践ステップ

- EU AI法には「適用除外・特例」もある:過度に恐れないための視点

- 業界別:あなたのビジネスが“近いかもしれない”リスク領域

- 部署別に見る「EU AI法対応」の役割分担と会話の型

- 今すでに使っているSaaS/生成AIをどう整理するか

- 既存AI(レガシーシステム)はどう扱われるのか?

- 中小企業・スタートアップ向け:ミニマム対応の考え方

- EU内部の議論と見直し:Digital Omnibus・過規制論・ブリュッセル効果【最新動向アップデート枠】

- EU AI法を“攻め”の材料にもする:AIガバナンスとビジネスの接点

- よくある質問(FAQ)

- まとめ:不安を「継続的な見直し」と「小さな一歩」に変える

- 用語ミニガイド(初心者向けスモール辞書)

- あなたのAIは EU AI法でどのリスクに近い?3問で分かる!

はじめに:こんな不安、ありませんか?

1-1「EUに拠点がないから関係ない」と思っている方へ

EU AI法(AI Act)はしばしば「欧州企業向けの法律」と理解されます。しかし実際には、次のようなケースでも対象になり得ます。

- 日本のSaaSに搭載したAI機能が EU ユーザーに利用される

- EU企業との契約で「AI Act準拠」を求められる

- AIモデルが EU 域内で利用される

つまり、EUに拠点がなくても関わり得る「域外適用」の要素があるということです。

1-2. 実務者が抱えやすい3つのモヤモヤ

- 「うちのAIは対象なの?」

- 「SaaSのAI機能はどう扱う?」

- 「社内にどう説明する?」

これらは、全体像と時系列を理解することで大きく解消されます。

1-3. 本記事の目的と限界(情報提供・免責事項)

本記事の目的

- 法律を実務者向けに翻訳する

- 2024〜2027年のロードマップを俯瞰する

- 中小企業が今日からできる「最小限アクション」を提示する

ただし、本記事は情報提供であり、個別の法的助言ではありません。内容は 2026年1月時点 の情報に基づいています。

まず全体像を知るだけで、漠然とした不安が“いつまでに何をするか”という明確なタスクに変わっていきます。

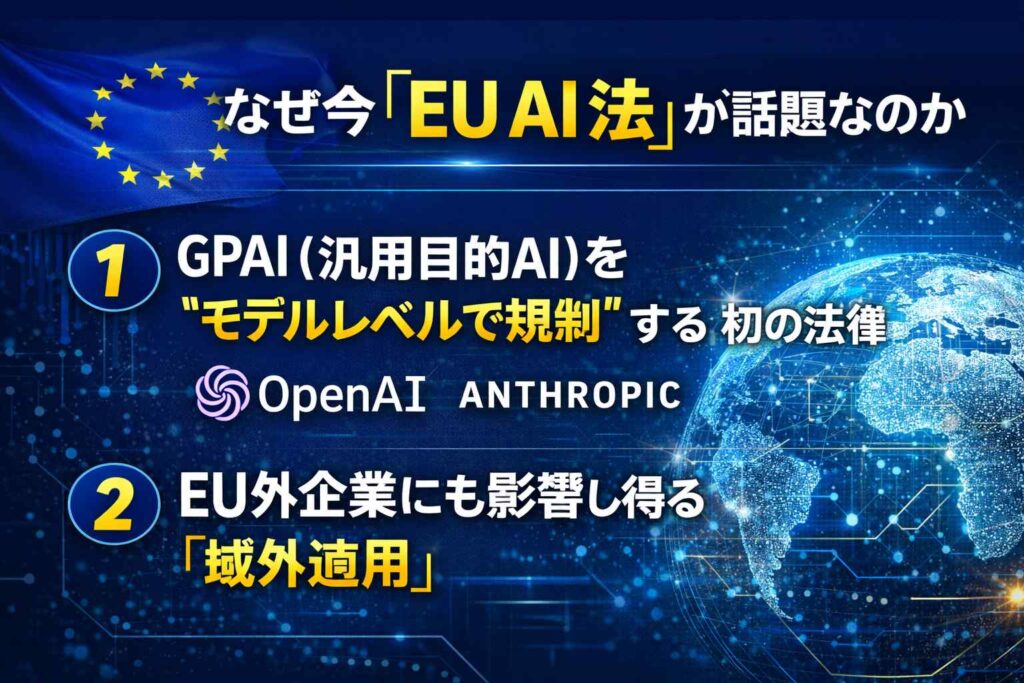

なぜ今「EU AI法」が話題なのか

EU AI法が注目される理由:

EU AI法は、単なるAI関連の法律ではありません。“世界初”の包括的AI規制であり、GDPRと同じく世界的な影響力を持つと見られています。

背景には以下があります:

- AIの社会的リスク(偏り・誤作動・透明性不足)への懸念

- ChatGPT以降の生成AIブーム

- 自動化による意思決定の透明性問題

- AI市場を巡る国際競争の激化

- 人権・民主主義・安全性を重視するEUの価値観

特に以下2点が非常に大きいインパクトを持ちます。

① GPAI(汎用目的AI)を“モデルレベルで規制”する初の法律

OpenAI、Anthropic、Google などの基盤モデル開発者に対し、透明性・評価・データガバナンス等の義務が課されます。

② EU外企業にも影響し得る「域外適用」

GDPR同様、AI Actも世界的に影響が及ぶと考えられています。

この記事の前提・参照元

3-1. EU公式一次情報

EU AI法を扱うなら、まず押さえるべきは以下です。

- EU官報(Official Journal)

- EU AI Office(行動規範・ガイドライン・FAQ)

- AI Act Explorer

- 条文検索がしやすい

- “Annex I / III のどこに該当するか”をすぐ調べられる

3-2. 日本語の公的リソース

3-3. 記事更新方針と情報の有効期限

EU内部では 2025年末〜2026年にかけて一部義務開始の延期案 なども議論されています。

そのため本記事は 2026年1月時点 の情報であり、最新情報は AI Office などで確認することを推奨します。

EU AI法(AI Act)の全体像を3分で掴む

EU AI法(AI Act)は、AIシステムを「リスクの高さ」で分類し、そのリスクに応じて義務が変わる“リスクベースアプローチ”を採用しています。

4-1. 法律の基本情報 EU AI法の目的・適用範囲

EU AI法の目的を、あえて一言でまとめると、「AIのリスクに応じたルールを設け、人権・安全を守りながらイノベーションも促進する」というバランスを目指した規制、と言えます。

主なポイントは次の3つです。

- 世界初の包括的AI規制(AIシステムを横断的にカバー)

- リスクベース・アプローチ(用途とリスクに応じて義務が変わる)

- 事業者の立場ごとの義務(provider / deployer / importer / distributor 等)

対象となるのは、「AIシステム」や「汎用目的AIモデル(GPAI)」で、人の行動・環境に重要な影響を与えうるものほど厳しい要件が課されていきます。

4-2. 4つのリスク区分と代表的ユースケース

EU AI法では、AIを次の4つに分類します。

① 禁止AI(Unacceptable Risk)

例:

- 社会的スコアリング

- 児童の脆弱性を利用した操作的AI

- リアルタイム生体認証(公的機関による一部例外はあり)

② 高リスクAI(High Risk)

以下の Annex に分類される用途:

- Annex III(分野ベースの高リスク)

- 雇用・採用

- クレジットスコア

- 教育の成績評価

- 医療診断支援

- 司法支援

- Annex I(製品安全規格と連動する高リスクAI)

- 医療機器

- 自動車

- 玩具

- エレベーター

※こちらは製品カテゴリによって 2027 年まで適用時期がずれる

③ 限定リスクAI(Transparency Obligations)

例:

- AIチャットボット

- ディープフェイク

- コンテンツ生成AI

→ 「AIが生成したことを明示する」 義務など

④ 最小リスクAI

例:

- AIゲーム

- 文章校正AI

- 画像編集AI

※最終的な区分は用途・実装によって異なり、個別判断が必要です。

ここに図解(リスクマトリクス:4区分 × 代表ユースケース)を挿入

4-3. GPAI(汎用目的AI)と基盤モデルの扱い

ChatGPT / Claude / Gemini などの基盤モデル(Foundation Models)や、それを組み込んだサービス(GPAI:General-Purpose AI)は、AI Act の中で重要な位置づけを占めます。

GPAI向けの行動規範(Code of Practice) が2025年以降公開され、AI Office により更新されています。

実務的には以下が重要です:

- モデル提供者:透明性義務・サプライチェーンへの情報提供

- 事業者:モデルの特性を理解し、用途のリスク評価を行う

特に中小企業は、既存のSaaSがAI Act準拠をどう実装するかをベンダーに確認する必要があります。

4-4. 事業者の立場(provider / deployer 等)を理解するためのキーワード

EU AI法では、単に「AIを使う側/作る側」ではなく、役割で義務が変わる点が最重要です。

- Provider(提供者):AIシステムを開発・販売する側

- Deployer(利用者):AIを業務で使う側

- Importer(輸入者)

- Distributor(流通者)

日本企業の多くが該当するのは Deployer(利用者) で、義務は比較的軽めですが 「使い方」によるリスク管理が求められます。

2024〜2027年:フェーズ別タイムラインと検討のヒント

EU AI法は「今日施行されたら明日全義務」という形ではありません。2024〜2027 年にかけ、分野ごと・AIの種類ごとに適用が段階的に始まります。

5-1. 発効から2027年8月までの段階的適用イメージ

ここで把握すべきは 「2026年と2027年のズレ」 です。

- 禁止AI(2025年2月〜)

- GPAI / 基盤モデル義務(2025年8月〜)

- Annex III(高リスクAI:分野) → 2026年8月〜

- Annex I(製品安全関連の高リスクAI) → 2027年8月〜

つまり、2026〜2027 にかけて高リスクAIの適用が段階的に動く特にレガシーシステム(既存AI)は 2027 年 8 月 が大きな節目という構造です。

また、技術基準については高リスクAI向けの Harmonised Standards(調和規格) は

CEN/CENELEC によって2026年に草案が公開されつつあります。

エンジニア層にとっては、この規格動向も非常に重要です。

5-2. フェーズごとに“検討が推奨される”タスク例

2024〜2025(基礎固め)

- 自社AIの棚卸し

- ベンダー調査

- 最小限の社内AIルール策定

2025〜2026(GPAI対応・禁止AIの線引き)

- 生成AI利用の透明性ルール

- データ入力制限

- 部署別ガイドライン整備

2026〜2027(高リスクAI/レガシーAIの見直し)

- 技術文書・精度評価の準備

- 高リスクに該当する可能性のある業務の洗い出し

- レガシーAIの2027年8月までの計画策定

5-3. 延期・見直しが議論されている点への注意

2025 年末時点で EU内部では

- 高リスクAIの一部義務の延期

- 中小企業支援策

- Digital Omnibus による再調整

などが議論されています。

そのため「変化する前提」でタイムラインを捉えることが安全です。

うちは対象なの? チェックポイント

EU AI法は、「業種」ではなく 用途(Use Case) によって義務が決まります。

そのため、まずは “自社のAIがどこに当てはまるか” を判断するための整理 が必要です。

チェックポイント①:EUユーザーに提供しているか?

- EU企業との取引がある

- SaaSにEUユーザーがアクセスする可能性がある

- EU企業の子会社が日本のサービスを使っている

→ EU域内の利用が1つでもあれば、対象の可能性あり

チェックポイント②:AIの「用途」は何か?(Annex III / I)

以下に該当すると、高リスクの可能性があります:

- 採用フィルター

- クレジット審査

- 医療診断支援

- 教育評価

- インフラ運用(電力・交通)

- 法執行支援(司法関係)

チェックポイント③:AIは「意思決定」に関与しているか?

- 人事

- 採点

- スコアリング

- 自動意思決定

これらは 透明性・説明責任 が求められ、義務が重くなりやすい領域です。

チェックポイント④:生成AI(GPAI)を利用しているか?

- ChatGPT / Claude / Gemini を業務利用

- これらを組み込んだSaaSを使用

- APIを使用して自社アプリに統合

これらは 2025年8月以降の義務 と関係する可能性があります。

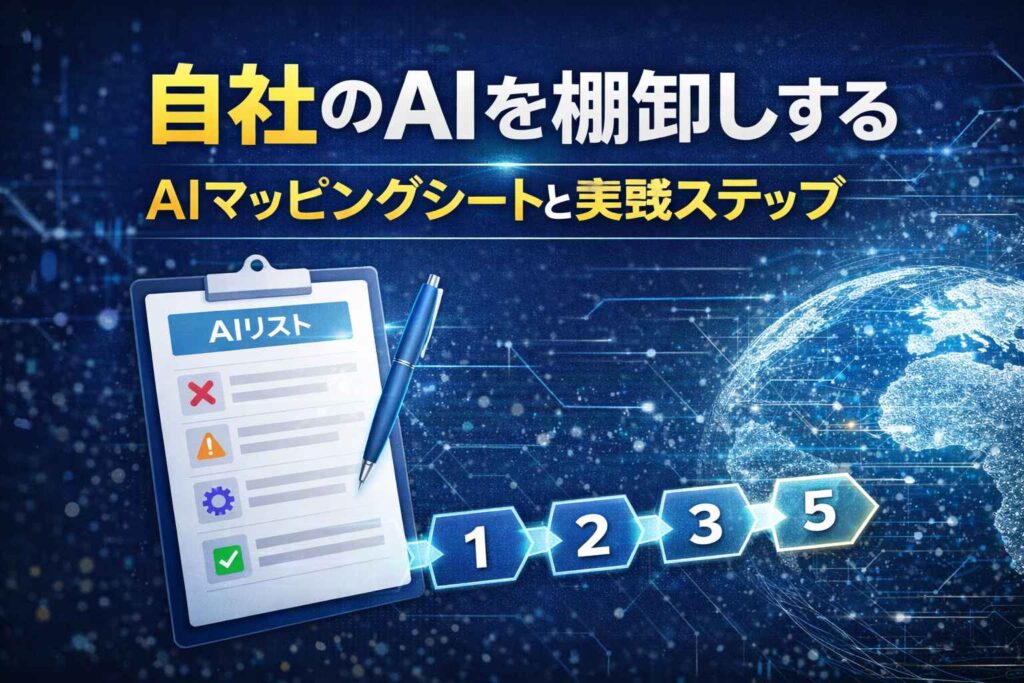

自社のAIを棚卸しする:AIマッピングシートと実践ステップ

AI Actへの対応は、「AIを使っているかどうか」ではなく、「どう使っているか」が重要です。

そのため、まず取り組むべきは AIの棚卸し(インベントリ作成) です。

7-1. AIマッピングの基本ステップ

- AIを使っている業務の洗い出し

例:問い合わせ対応、採用評価、データ分類、広告運用 など - AIの種類・仕組みの理解

- ルールベース

- 機械学習

- 生成AI(GPAI) - AIの役割を記述する

- 補助的?- 意思決定に直接関わる?

- 自動化の程度は?

- 入力データ・出力データを確認する

個人データの扱いは特に重要 - リスクの可能性を暫定評価

7-2. 「コピーして使える」AIマッピングシート例

- AIの名称/ベンダー

- 利用部署

- 入力データ

- 出力データ

- 意思決定関与の程度

- EUユーザーの有無

- 高リスク該当可能性

- 既存/新規(レガシーAI判定)

記事内では そのままコピペできるチェックリスト形式 で掲載します。

👉 PDF/スプレッドシートへ転記してカスタム利用することを推奨

EU AI法には「適用除外・特例」もある:過度に恐れないための視点

AI Act は非常に厳しい法律に見えますが、実務上は すべてのAIが縛られるわけではありません。

意図的に「例外・特例」が設けられており、これはイノベーションを阻害しないための重要な仕組みです。

8-1. 適用除外されるケースの例

- 研究開発(R&D)目的のAI

- 試験・検証段階のAI

- 軍事用途(別規制)

- 非自動化システムに付随する部分的AI

8-2. オープンソースモデルの扱い

オープンソースAIに対しては、負担を軽減する方向で議論が進んでいます。

AIコミュニティへの影響を最小化するため、義務の一部が緩和される方向の検討も続いています。

8-3. サンドボックスとしての考え方

AI Act は、イノベーションを育てるために「安全に実験できる場(サンドボックス)」 を提供しています。

これはイノベーションを止めるための“抜け道”ではなく、安全に試せる『守られた実験場』 という仕組みです。

業界別:あなたのビジネスが“近いかもしれない”リスク領域

EU AI法では「業界規制」というより“AIの用途”によってリスクが決まる 仕組みです。

しかし、実務で考える際には“どの業界に多いか” を把握しておくと判断しやすくなります。

以下は Annex III(高リスクAI)で特に登場頻度が高い領域です。

● 人事・採用(HR Tech)

- エントリーシート選別

- 面接評価AI

- 適性検査自動化

→ 差別・不当評価のリスクから高リスクに該当し得る分類

● 金融(FinTech / Credit)

- クレジットスコア

- 融資審査

- 不正検知

→ 意思決定に直結する領域であり、規制対象になりやすい

● 医療・ヘルスケア

- 診断支援AI

- 医療画像解析

→ Annex I(医療機器規制)とも密に連動

● 教育テクノロジー(EdTech)

- 学習評価AI

- 試験の自動採点

→ 公平性・透明性の観点で高リスク化しやすい

● インフラ・公共領域

- 交通最適化AI

- エネルギー管理

- スマートシティAI

→ 公共安全に関わるため義務が重くなりやすい

● 法務・司法支援AI

- 判決予測AI

- 証拠評価支援AI

→ 高い透明性と説明責任が求められる

ポイント

業界でなく “どう使っているか” が本質です。「高リスクに入りそうな用途があるか」を業務単位で見ていく必要があります。

部署別に見る「EU AI法対応」の役割分担と会話の型

AI Actの対応は、1部署だけで完結しません。特に中小企業では「役割の掛け持ち」が発生しがちです。

以下は、社内会議や説明時に使える 部署別の役割・会話テンプレート です。

● 経営層(CEO / 事業責任者)

役割:方針決定・リスク承認

質問例:

- 「うちが EU AI Act に該当する可能性はどれくらいありますか?」

- 「今すぐ必要な対応と、来年以降でよい対応を分けて説明してください」

● 法務・コンプライアンス

役割:契約、透明性、免責、ガイドライン作成

会話の型:

- 「このAIの用途は Annex III に該当する可能性がありますか?」

- 「説明責任(ドキュメント)を整える必要がありますか?」

● 情報システム(情シス / IT)

役割:技術面の実装判断・ベンダー確認

会話の型:

- 「提供元は GPAI 行動規範に沿った情報を開示していますか?」

- 「大幅な変更(Significant Change)は発生しそうですか?」

● 各事業部(マーケ・営業・企画・現場)

役割:AIの実際の使われ方・データの管理

会話の型:

「入力データに個人情報は含まれますか?」

「このAIは何を自動化していますか?」

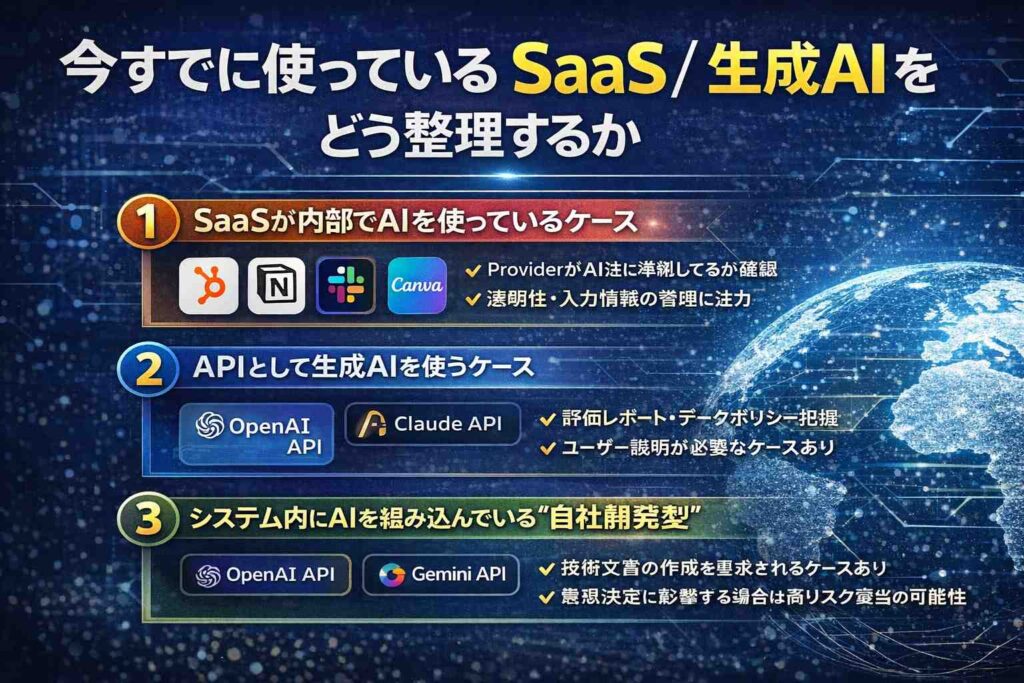

今すでに使っているSaaS/生成AIをどう整理するか

SaaSの多くが内部でAIを使用しており、利用者(Deployer)の側では “どこまで自社が責任を持つか” の線引きが必要です。

① SaaSが内部でAIを使っているケース

例:

- HubSpot(レコメンド)

- Notion AI(要約・執筆支援)

- Slack AI(検索・要約)

- Canva AI(画像生成)

対応ポイント:

- 提供者(Provider)がどこまで AI Act 準拠しているか確認

- 利用者としては 透明性・入力情報の管理 に注力

② APIとして生成AIを使うケース

例:

- OpenAI API

- Claude API

- Gemini API

対応ポイント:

- モデル情報(評価レポート、データポリシー)を把握

- ユーザーへの説明が必要となるケースあり

③ システム内にAIを組み込んでいる“自社開発型”

対応ポイント:

- 技術文書の作成が求められるケースあり

- データ品質の確認

- 意思決定に影響する場合は高リスク該当の可能性

既存AI(レガシーシステム)はどう扱われるのか?

ここは担当者が最も不安を抱えやすいポイントです。特に EU AI法では “2027年8月2日” が大きな節目 になります。

ただし――

全企業が“2027年8月までに必ず整備しなければならない”わけではありません。

ここは用途・役割・変更の有無によって大きく変わるため、あくまで 検討の目安 として整理します。

「すでに市場にあるAI」に義務が生じるケースの全体像

既存AI(レガシー)については、“今動いているものが即違反になる” わけではありません。

基本的な考え方は:

1. 高リスクAI(Annex III)

すでに市場にある AI でも、大幅な変更(Significant Change)が 発生した場合、新規と同等の義務が発生し得る。(例:モデル変更、アルゴリズムの大幅差し替え など)

2. 公共機関が利用する高リスクAI

施行後 2〜4年以内に移行していく見通し。

3. 製品安全系(Annex I)

こちらは 2027年8月以降 の適用が中心。医療機器・自動車・玩具など。

GPAI(生成AI等)と既存モデルの猶予期間の考え方

GPAI / 基盤モデルの場合:

- 2025年8月以前 に市場にあったモデルは

- 2027年8月2日までに必要な義務を果たすことが求められる(透明性・文書化・評価など)

ただしこれも “一律の強制” ではなく用途によってどの義務が必要かが変わるため、まずは “どの程度触っているか” を把握するのが重要です。

既存システムを棚卸し・見直しするときのステップ例

- どれが「レガシーAI」かを分類する(自社開発、SaaS内部、GPAI APIなど)

- 変更予定の有無を確認(細かいアップデートなのか、大幅変更なのか)

- 2027年8月を1つの“検討目安”としてロードマップに反映

2027年8月までに“義務を果たすことが求められる”可能性がある領域を、まずは把握するだけでOKです。

中小企業・スタートアップ向け:ミニマム対応の考え方

「結局、何から手をつけるべきなの?」

この悩みに答えるためのセクションです。

EU AI法は複雑ですが、“最初の3ヶ月にやるべきこと” を明確にすると一気にラクになります。

最初の3ヶ月で試したい3ステップ

Step 1:AIの棚卸しを始める(AIマッピング)

→ すべての対策の基礎

Step 2:ベンダーへ確認しておくとよい質問例

- AI Act 準拠の予定はありますか?

- GPAI行動規範に沿った情報開示はありますか?

- モデル情報(データ仕様・評価レポート)の共有は可能ですか?

Step 3:社内説明会/共有会を1回実施

- AI Act の概要

- 自社AIの棚卸し状況

- 簡易ルール

→ これだけで、社内の“先行き不安”が大幅に減る

従業員向けAIリテラシー(Article 4)教育:5〜10分でできるカリキュラム例

※このまま “読み上げ” ても社内勉強会として成立する構成です。

(1)導入:なぜ今AIリテラシーが必要なのか(1分)

- ChatGPT・Copilot などAI使用が急速に増えている

- EU AI法の Article 4 では 教育の重要性 が明記されている

- 今日話すのは “難しい法規制” ではなく、“現場で困らないための基礎”

(2)AIでできること/できないこと(1分)

AIが得意: 要約・分類・パターン抽出

AIが苦手: 事実確認・価値判断・最新性・責任の所在

例:「AIは“賢い部下”ではなく、“仕事が早いインターン”くらいのイメージで」

(3)自社のAI利用ルールの3原則(2分)

- 秘密情報を入力しない

- AIの出力は“提案”として扱う

- 迷ったら相談する

(4)EU AI法との関係(1〜2分)

- AI Act は AI を4つのリスクに分類

- 私たちが条文を覚える必要はない

- ただし「使い方によっては海外規制も関係する」ことだけ押さえておく

(5)今日から1つだけ従業員にお願いしたいこと(1分)

例:

- 「社外秘の数値は AI に入れない」

- 「AIで作った文章は一言注記する」

(6)締め:不安を減らすメッセージ(30秒)

「AIを使うこと自体は問題ではありません。正しく“線引き”しながら使えば、仕事がむしろ楽になります。」

(7)教育ログ(記録)を残す

※教育を実施した際は、「いつ・誰に・何を教育したか」 を記録として残しておくことを推奨します。これは EU AI法が重視する「適切なガバナンス」の強力な証跡になります。

半年〜1年で整える「枠組みづくり」

- 最小限のAI利用ガイドラインを作る

- 定期的な見直しサイクルを組む

- ベンダー評価の仕組みをつくる

完璧な準拠を一度に目指す必要はありません。“ここまでできれば次の一歩が踏み出しやすい” というラインを決めることが大切です。

EU内部の議論と見直し:Digital Omnibus・過規制論・ブリュッセル効果【最新動向アップデート枠】

ここは “最新情報を都度追記する場所” として活用できるセクションです。EU AI法は発効後も、多くの論点が動き続けています。

EU内部で高まる「過規制」への懸念

AI Act は世界的に注目される一方で、EU内部では次のような懸念も指摘されています。

- スタートアップが負担を負いすぎる

- 規制準備でイノベーションスピードが遅れる

- 世界のAI競争で不利になる可能性

これを受け、いくつかの規制要素について「適用時期を緩和・延期すべき」という声 が高まっています。

Digital Omnibus(デジタル一括見直し)とは何か?

EUはデジタル政策を体系的に見直すため、Digital Omnibus(一括改正)と呼ばれる議論を進めています。

AI Actもこの流れの中で改訂・調整が行われる可能性があり、

- 一部義務の延期案

- 中小企業向け救済措置

- GPAI向け義務の微調整

などが検討されている状況です。

ブリュッセル効果(Brussels Effect)と国際標準化

GDPRに続き、AI Actが世界標準になることで

- 日本企業も EU の基準に準拠する必要が出てくる

- 他国も EU基準に寄せたAIルールを作る可能性

など、国際的な影響力(ブリュッセル効果) が指摘されています。

特に GPAI モデルは、米国・日本・EUでの共通基準(技術評価・透明性)の形成が期待され、AIの世界標準争いの中心になると見られています。

EU AI法を“攻め”の材料にもする:AIガバナンスとビジネスの接点

EU AI法は「守りの法律」というイメージがありますが、実は 攻めのビジネス戦略にも活用できます。

● 顧客・パートナーへの説得材料になる

「当社は EU AI法に基づき AIガバナンスを整備しています」

→ B2B商談での信頼性が劇的に向上

● 競合との差別化になる

- AIの透明性

- データ品質

- ログ管理

- モデル評価の情報共有

これらは “安全なAIを提供できる会社” としてのブランディングに直結。

● 海外展開(特に欧州)での参入障壁を下げる

今後、欧州市場に参入する企業や欧州の企業とサービス連携する企業にとって、“AI Act準拠” が信用の土台になる可能性が高いです。

● 社内での「AI活用文化」を加速させる

法律をきっかけに、

- 棚卸し

- データ整備

- ガイドライン作成

- リテラシー教育

が進むことで、会社全体での AI活用レベルが底上げされます。

AI Actは脅威でなく、ビジネスの“準備運動”として使うことで、攻めにも守りにも強い企業になることができます。

よくある質問(FAQ)

ここでは、実務担当者から特に多い質問をまとめています。

Q1. 日本企業でも EU AI法の罰則対象になり得ますか?

A:

可能性はありますが、「EUユーザーが使うかどうか」「用途が高リスクかどうか」などによって大きく異なります。

EUに現地法人がなくても、

- SaaSの利用者にEUユーザーがいる

- EU企業と取引している

- AI出力がEU域内で使用される

といったケースでは対象となる可能性があります。

Q2. 生成AI(ChatGPT / Claude / Gemini)を利用しているだけで義務は発生しますか?

A:

利用者(Deployer)に一律の義務が課されるわけではありません。

ただし:

- 透明性

- 入力データの管理

- 従業員教育(Article 4)

など、軽微ではありますが「運用面の対応」 が必要となるケースがあります。

Q3. 専門家(相談先)はどう探すべきですか?

A:

以下のキーワードで探すのが有効です。

- 「AIガバナンス」

- 「IT法務」

- 「欧州規制(EU regulation)」

- 「デジタル政策」

相談先としては:

- 弁護士(テック法務/国際法務)

- AIガバナンスに詳しいコンサル企業

- 大学・研究機関

- 産業支援機関・JETRO

が候補になります。

Q4. まず“何をやればいいか”だけ知りたいです。

A:

最初の一歩はこの3つです。

- AIの棚卸し(AIマッピング)

- ベンダーに基本質問

- 社内説明会を1回実施

この3つだけで、EU AI法対応の 7〜8割は“方向性が見える”ようになります。

まとめ:不安を「継続的な見直し」と「小さな一歩」に変える

EU AI法は複雑で、変化し続ける大きな制度です。

しかし、1つひとつ小さく整理することで、不安は “行動できる要素” へと分解できます。

本記事のまとめ

- EU AI法は 用途ベース の規制

- 2024〜2027で段階的に適用

- レガシーAIは 2027年8月が1つの節目

- GPAI(生成AI)は行動規範(Code of Practice)が重要

- 中小企業・スタートアップは ミニマム対応で十分開始可能

- 教育義務(Article 4)により、従業員のAIリテラシーが鍵

- 最新動向は AI Office・EU官報 で確認するのが安全

- 過度に恐れず、「小さな一歩」を積み上げることが最重要

不安を減らす最後のメッセージ

この法律は「完璧さ」を求めるものではありません。むしろ、企業に“継続的な見直しのサイクル”を促す仕組みです。まずは1年に1回、自社AIの棚卸しと最新情報チェックをするだけで十分です。

- 本記事は2026年1月時点の情報

- EU AI法は“完了する取り組み”ではなく“サイクル”

- 年1回の棚卸しが推奨される

用語ミニガイド(初心者向けスモール辞書)

EU AI法で頻出する専門用語を、初心者でも迷わないよう 短く・やさしく まとめました。

■ GPAI(General-Purpose AI/汎用目的AI)

ChatGPTやClaudeなど、幅広い用途に使えるAI。

■ Foundation Model(基盤モデル)

大規模データで事前学習し、さまざまなタスクに適応できるAIモデル。

■ Annex I(製品安全関連の高リスクAI)

医療機器や自動車など、安全規制が既にある製品に組み込まれるAI。

■ Annex III(分野ベースの高リスクAI)

雇用・信用・教育など、特定分野における高リスクAI。

■ Harmonised Standards(調和規格)

EUの標準化機関(CEN/CENELEC)が策定する、高リスクAIの技術要件の指針。2026年時点で草案が複数公開中。

■ AI Office(欧州委員会内のAI専門機関)

GPAI行動規範の管理、FAQ、技術ガイダンスの公開などを行う。

■ Significant Change(大幅な変更)

既存AIに対して「新規と同等の義務が発生するかどうか」を分ける重要概念。

例:モデルの根本的変更、ロジックの大規模アップデート。

■ Transparency Obligations(透明性義務)

チャットボット・コンテンツ生成AIなど、利用者に「AIであることを知らせる」必要があるルール。

あなたのAIは EU AI法でどのリスクに近い?3問で分かる!

あなたのAIは EU AI法でどのリスクに近い?自己診断クイズ

※すべて「概ねの傾向」を掴むための簡易チェックです。最終的な判断は、用途・データ・設計によって異なります。

Q1. あなたのAIは、意思決定に直接関わっていますか?

A. はい(採用評価・審査・診断など)

B. いいえ、補助的に使っているだけ

C. 生成AIで文章や画像を作っているだけ

→ A が多い場合:高リスクAIの可能性

→ B/C の場合:限定リスク〜最小リスク領域が中心

Q2. EUユーザーが使う可能性はありますか?

A. すでに利用している

B. 可能性はある

C. 日本国内のみ

→ A/B の場合:EU AI法の対象「になり得る」可能性

→ C:ただし将来の市場展開によっては該当の余地あり

Q3. モデルを“自社で開発・改修”していますか?

A. アルゴリズムを自社開発している

B. 外部APIを組み込んでいる

C. SaaSとして既製品を使っている

→ A:Provider(提供者)側の義務に近づく可能性

→ B/C:Deployer(利用者)としての軽めの義務が中心

(診断の見方)

Cが多い → 限定リスク〜最小リスク中心

Aが多い → 高リスク/ベンダー相談必須

Bが多い → 用途の線引きを要確認

コメント