導入:AIの判定が「よく分からない」まま受け入れられていないか

融資の審査に落ちた理由を尋ねても、「AIによる総合的な判断です」とだけ説明される。

採用AIのスコアが想定より低く、担当者に根拠を聞いても、曖昧な説明しか返ってこない。

医療AIが提示する診断結果と、長年信頼してきた医師の見立てが異なったとき、どちらをどのように判断材料にすべきか迷ってしまう。

こうした経験や不安を、SNSやニュースのコメント欄などでも示唆する声として見かける機会が増えてきた、と感じる人も少なくありません。

「AIの評価が、自分の将来にどこまで影響しているのか分からない」

「説明を読んでも専門用語が多く、納得しきれない」

「もしAIが間違っていたと感じても、どこに相談すればよいのか分からない」

ここにあるのは、単なる「新しい技術だから不安」という感情だけではありません。

- どの情報をどのように使っているのかが見えにくい

- その結果がどの程度、権利や機会に関わるのかが分かりにくい

- 間違いや不公平を感じたとき、どう異議を唱えればよいかが見えない

といった構造的な不透明さへの懸念が、AIへの不信感の土台になっています。

関連記事➤「AIが怖い」人へ|初めてChatGPTを使って分かったこと3つ【実体験】 | skyday

一方で、医療・金融・行政・採用など、人々の生活に直結する領域でAIの活用は着実に進んでいます。

その中で「なぜその判断に至ったのか」を人間が理解し、必要に応じて問い直せるようにすることは、特に高い説明責任を伴う場面では、プライバシー保護や安全性確保など他の要素と並んで、AIを社会に受け入れてもらうための重要な条件の1つとして意識されるようになっています。

こうした背景から注目されているのが、説明可能AI(XAI:Explainable AI)です。IBMなども、説明可能AIを「人間がAIの出力を理解し、信頼できるようにするためのプロセスや方法の総称」と位置づけています。

さらに、

- EU AI Act(欧州AI規制法)

- ISO/IEC 42001(AIマネジメントシステム)

- NIST AI RMF(AIリスクマネジメントフレームワーク)

- 日本の「人間中心AI社会原則」や「広島AIプロセス」

など、国内外でAIガバナンスの枠組みも整いつつあります。

本記事では、こうした最新の動きを踏まえながら、

- なぜ私たちはAIを素直に信じられないのか

- 説明可能AI(XAI)とは何か、その手法と限界

- EU / 米国 / 日本を中心とした規制・標準の流れ

- 2026〜27年までに企業が現実的に準備すべきXAI導入ステップ

- 生活者としてAIの判定にどう向き合うか

- そして、XAIを「AIを疑うためのインフラ」としてどう活かすか

を整理し、「AIをどの条件なら慎重に信頼してよいか」を考えるための土台を提供します。

また下記記事では、AIを使うのに抵抗がある人向けに作成しています。AIの活用を考えるのに参考になります。

➤2026年版|AIが怖い人のための現実ガイド — 不安・誤解・対処法を徹底解説 | skyday

- 【説明可能AI(XAI)とは?】

- 1 なぜAIの判定は「よく分からない」まま使われてしまうのか

- 2 「XAIを入れれば安心」は本当か──よくある3つの誤解

- 3 XAIとは?定義・背景・手法を3分で整理する

- 4 ガバナンスと規制:EU AI Act・ISO/IEC 42001・日本/各国の動き

- 5 XAIのメリット・デメリットと「ブラックボックスAI」との違い

- 6 業界別のXAI活用と失敗事例(医療・金融・人事)

- 7 2026〜2030年:AIは「性能」だけでなく説明とガバナンスで選ばれる時代へ

- 8 企業が2026〜27年までに整えたいXAI導入ステップ

- 9 XAIツールと選び方──内製かSaaSか、誰のための説明か

- 10 生活者としてAIの判定に向き合うためのチェックリスト

- 11 XAIを「AIを疑うためのインフラ」として活かす──信頼をつくるための視点

- 12 まとめ:AIを慎重に信頼するために、今からできること

【説明可能AI(XAI)とは?】

- XAI(説明可能AI)とは、AIの判断理由を人が理解できる形で示すための「技術・仕組み・運用プロセス」の総称。

- 医療・金融・採用など、人の生活や権利に影響する領域ほど重要性が高い。

- 2026年以降は、EU AI Act・ISO/IEC 42001などの規制により、精度だけでなく「説明・透明性・ガバナンス」を備えたAIが求められる流れが明確になっている。

1 なぜAIの判定は「よく分からない」まま使われてしまうのか

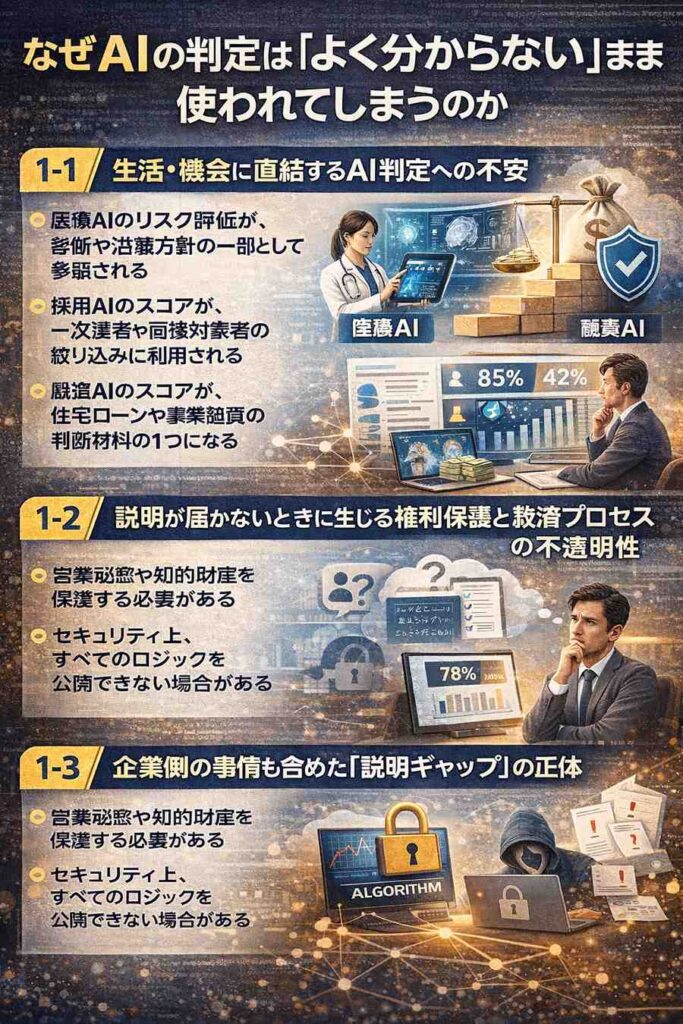

1-1 生活・機会に直結するAI判定への不安

AIの判定は、すでにさまざまな場面で使われています。

- 医療AIのリスク評価が、診断や治療方針の一部として参照される

- 採用AIのスコアが、一次選考や面接対象者の絞り込みに利用される

- 融資AIのスコアが、住宅ローンや事業融資の判断材料の1つになる

多くの法域では、最終的な判断に人間が関与することが原則とされていますが、AIの出すスコアや分類結果が、意思決定の重要な要素になりつつあるのは確かです。

そのため利用者は、

「自分では仕組みを確かめきれないまま、結果だけを受け取ってよいのか?」

という不安を抱きやすくなります。ここには「AIが間違えるかもしれない」という技術的な不安に加え、

「どうやってチェック・修正すればよいかが見えない」ことへの懸念が含まれています。

1-2 説明が届かないときに生じる権利保護と救済プロセスの不透明性

「なぜこの結果になったのか」と質問しても、

- 専門用語が多い説明文

- 数式や内部ロジックの断片的な解説

- 自分の状況とどう関係するかが分かりにくい定型文

といった情報しか得られない場合、説明を受けていても、適切な判断や行動をとることが難しくなるおそれがあります。

さらに、

- 問い合わせ窓口や異議申立ての手続きが分かりにくい

- 人間による再評価をどのように求めればよいのかが明示されていない

といった状態では、

「不利益を感じても、どこで・誰に・何を伝えればよいのか分からない」

という、権利保護と救済プロセスの不透明性への不安も重なります。

欧州では、GDPRやEU AI Actの議論を通じて、「自動化された意思決定だけに従わない権利」や「人間による見直しを求める機会」が重要な論点とされてきました。

単に説明を出すだけでなく、人間が介在できるルートを確保することが信頼回復のカギだとされています。

1-3 企業側の事情も含めた「説明ギャップ」の正体

一方で、企業側には企業側の事情も存在します。

- 営業秘密や知的財産を保護する必要がある

- セキュリティ上、すべてのロジックを公開できない場合がある

- あまりに詳細な情報を出すと、かえって利用者が混乱したり、悪用リスクが高まることもある

- 説明画面の設計や運用にコストがかかり、過剰な情報提供はユーザーの認知負荷や利便性低下につながることがある

その結果、

「できるだけ正確に説明したい」という意図と、

「守るべき情報を守らなければならない」

「利用者の理解可能性や運用コストも考慮しなければならない」

という制約の間で、説明内容が制限されることも少なくありません。

このように、利用者の不安と企業の制約が交差するところに、XAIとガバナンスの設計が必要になると言えます。

2 「XAIを入れれば安心」は本当か──よくある3つの誤解

2-1 「説明画面さえ出せば責任は果たした」という誤解

XAIを導入すると、つい次のように考えがちです。

「説明画面を用意したのだから、説明責任は果たしているはずだ」

しかし、実際に重要なのは、

- 説明が、対象となる利用者にとって理解できるレベルか

- 説明の限界・不確実性が、事前に分かる形で伝えられているか

- 説明を踏まえて、人間側が判断を修正・変更できる運用になっているか

といったポイントです。

説明は「責任を免れるための免罪符」ではなく、対話と検証を始めるための窓口と考える必要があります。

2-2 「XAI=AIの中身がすべて見える」という誤解

XAIは、「AIの中身が完全に透明になる魔法の技術」と誤解されることもあります。

実際には、

- 複雑な内部計算をそのまま見せるわけではなく

- 人間が判断に使えるレベルに要約・翻訳するための技術・仕組み

であり、すべてを完全に理解できるようにすることを目的としているわけではありません。

現実的な目標は、「人が判断・検証できる範囲をどこまで広げられるか」というところに置くのが妥当です。

2-3 「XAI=精度を犠牲にする技術」という誤解と、最新の見方

かつては、

- 「説明可能なモデルは、精度が低い」

- 「高い精度を出すには、ある程度“ブラックボックス”を許容するしかない」

という見方が一般的でした。

しかし現在は、

- 説明手法を通じて、望ましくない相関やデータの偏りを発見し

- モデルを改善することで、長期的には精度・安定性・信頼性の向上につながる

という考え方が広がりつつあります。

つまり説明可能性は、短期的には追加コストに見えるかもしれませんが、中長期的にはリスク低減とモデル改善のための投資と捉えるほうが現実的です。

3 XAIとは?定義・背景・手法を3分で整理する

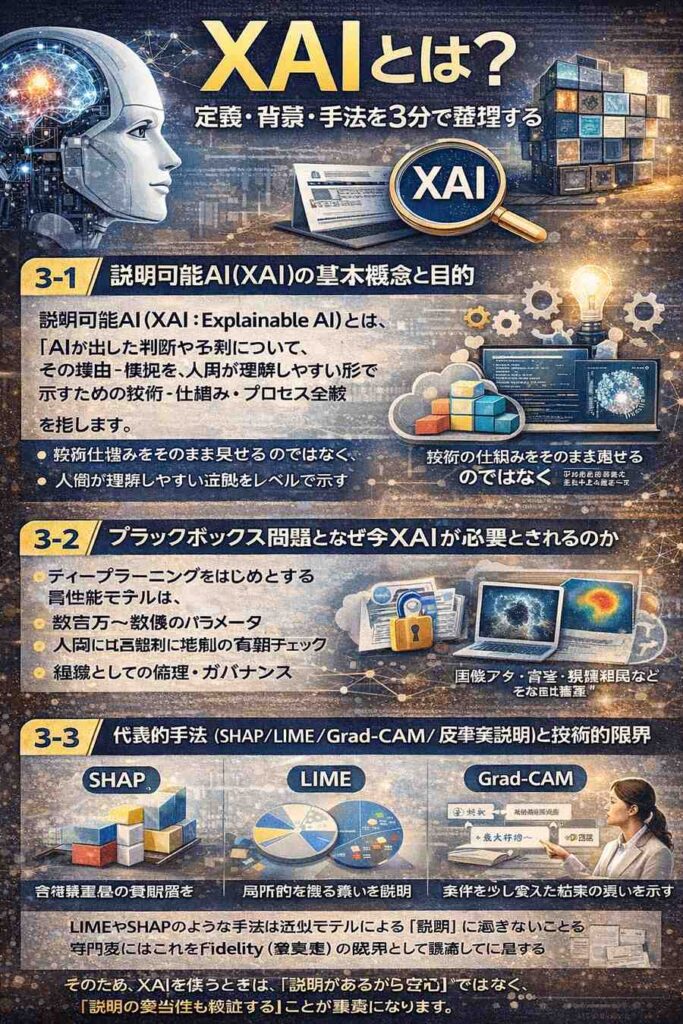

3-1 説明可能AI(XAI)の基本概念と目的

説明可能AI(XAI:Explainable AI)とは、

「AIが出した判断や予測について、その理由・根拠を、人間が理解しやすい形で示すための技術・仕組み・プロセス全般」

を指します。

ここで重要なのは、

- 内部構造をそのまま公開することではなく

- 「どの要因がどの程度効いたのか」「結果に特に寄与した特徴は何か」

を、利用者・監査者・規制当局などが意思決定や検証に使えるレベルで示すことです。

3-2 ブラックボックス問題と、なぜ今XAIが必要とされるのか

ディープラーニングをはじめとする高性能モデルは、

- 数百万〜数億のパラメータ

- 人間には直感的に把握しにくい高次元の相関関係

を内部に持っています。

モデルの構造や重みをすべて公開したとしても、それ自体がそのまま「人間にとっての理解」にはつながりません。

このギャップが、いわゆる「ブラックボックス問題」です。

例えば鉄道の現場AIでも「誤検知」「責任の所在」「職人技との関係」といった課題が指摘されています。

実際のデータと現場の声で安全性を検証したケーススタディについては下記の記事で詳しく解説しています。

➤鉄道AIは本当に私たちの命を守れるのか?─「誤検知」「責任」「職人技」の不安に、最新データで答える | skyday

医療・金融・行政など社会的影響が大きい分野では、

- 判断根拠の説明責任

- バイアスや差別の有無をチェックするための透明性

- 組織としての倫理・ガバナンス

といった点から、XAIの必要性が特に強く意識されるようになっています。

3-3 代表的手法(SHAP/LIME/Grad-CAM/反事実説明)と技術的限界

代表的なXAI手法を、用途とあわせて整理すると次のようになります。

LIME

- 特定の入力の近傍でシンプルなモデルを当てはめ、局所的な振る舞いを説明

- 画像・テキスト・表データなど幅広いデータ型に対応

SHAP

- 協力ゲーム理論のShapley値に基づき、各特徴量の貢献度を定量化

- 信用スコアやリスク評価など、根拠説明が重要な分野で多用

Grad-CAM

- 画像認識モデルが画像のどの部分を重視したかをヒートマップとして可視化

- 医療画像診断などで、「AIが病変部をきちんと見ているか」の確認に利用

反事実的説明(Counterfactual)

- 「年収があと◯万円高かったら?」「勤続年数が1年長ければ?」など、

条件を少し変えた場合に結果がどう変わるかを示す - 利用者が「次に何をすれば結果が変わりうるか」を理解しやすく、行動につながりやすい

ただし、LIMEやSHAPのような手法はあくまで近似モデルによる説明であり、もとの複雑なモデルを100%再現しているわけではありません。

専門的には、これをFidelity(忠実度)の限界として議論し、

- 説明用の近似モデルが、本来のモデルと異なる挙動をしてしまう

- にもかかわらず、説明だけを見ると「もっともらしく」感じられてしまう

といったリスクが指摘されています。

そのため、XAIを使うときは、

「説明があるから安心」ではなく、「説明そのものの妥当性も検証する」

という発想が重要になります。(記事の図解などで、「モデルの忠実性」と「人間の理解度」が必ずしも一致しないことを示すと、読者の理解をさらに助けることができます。)

4 ガバナンスと規制:EU AI Act・ISO/IEC 42001・日本/各国の動き

4-1 EU AI Actのリスク分類と段階的スケジュール

EU AI Actは、AIシステムを

- 許容できないリスク(原則禁止)

- 高リスクAI

- 限定的リスク(特定の透明性義務)

- 最小リスク

に分類し、それぞれに異なる義務を課す枠組みです。

タイムラインは段階的で、

- 2025年2月ごろ:禁止されるAI利用行為に関する一部規定が適用開始

- 2025年8月ごろ:汎用目的AI(GPAI)モデルに関する規定が適用開始

- 2026年8月ごろ:多くの高リスクAIに関する義務が施行予定

といったスケジュールが示されています(詳細は今後も調整が続く見込み)です。

重要なのは、

「スケジュールが変わるかもしれないから様子を見る」のではなく、

現行のタイムラインを前提に準備を進めつつ、最新情報を継続的にフォローすること

だといえます。

4-2 ISO/IEC 42001・NIST AI RMFに見るAIマネジメントの潮流

ISO/IEC 42001

- 2023年12月に発行された、AIマネジメントシステムの国際規格

- AIに関するリスク評価・責任分担・継続的改善などを含み、組織がAIを安全・安心に活用するための枠組みを提供します。

NIST AI RMF 1.0

- 米国の標準化機関が公開したAIリスクマネジメントのフレームワーク

- Explainability(説明可能性)とInterpretability(解釈可能性)を区別し、人がAIの出力を理解し、文脈に位置づけられることを重視しています。

これらは法規制そのものではありませんが、企業が自主的にAIガバナンスを高めるための基盤として、認証取得・導入検討が進みつつあります。

4-3 日本の「人間中心AI社会原則」「広島AIプロセス」と、中国など他地域の動き

日本では、

- 内閣府の「人間中心のAI社会原則」

- それを具体化するAIガバナンス・ガイドライン

- G7「広島AIプロセス」による国際的な指針作り

などを通じて、

「人権・民主主義・法の支配を前提としつつ、イノベーションを促進する」

という方向性が共有されつつあります。

当面はガイドラインなどのソフトローが中心ですが、日本においても、今後の社会実装の進展や国際的な調和の観点から、分野別の法的枠組みの必要性について継続的な議論が行われています。

一方、中国では、生成AIサービスや推薦アルゴリズムに対して登録制や表示義務、リスク評価手続きなどを課す規定が導入されており、国家による監督に加えて、安全性や消費者保護、知的財産保護といった観点も含めたアプローチが進んでいます。

アプローチは地域ごとに異なりますが、「AIの性能だけでなく、どのように説明し、責任を果たすか」が国際的な焦点になっている点は共通しています。

さらに、WTOなどの枠組みでは、企業の知的財産や営業秘密を保護する観点から、アルゴリズムの強制的な開示要求を制限しようとする議論も行われています。

透明性を求める動きと、過度な開示を避けるべきだという動きが並行して存在しており、

このバランスは今後の国際的な重要課題の一つです。

また、AI を安心して利用するためには技術面だけでなく、法制度による枠組みが不可欠です。

最新の EU AI Act や日本国内で進む AI 規制・法整備については下記記事で解説しています。

➤AI規制と法整備の最新動向|日本企業が取るべきリスク回避策と事例解説 | skyday

5 XAIのメリット・デメリットと「ブラックボックスAI」との違い

5-1 信頼性・透明性・公平性をどう高められるか

XAIを導入することで期待できるメリットは、主に次の3点です。

モデル挙動の理解

- どの要因がどの程度効いているかが見えやすくなり、

望ましくない相関やバイアスを発見しやすくなります。

説明責任の履行

- 利用者・規制当局・社内監査などに対して、

「なぜその結果になったのか」を説明しやすくなります。

ドメイン知識との対話

- 事業担当者や専門家が「この重み付けは妥当か?」と検証し、

モデルを共同で改善しやすくなります。

これらは、医療・金融・人事など、高い説明責任が求められる分野で特に重要です。

5-2 コスト・精度・運用負荷──トレードオフはどこにあるか

一方で、XAIには次のようなコストや課題もあります。

- 計算コストの増加(説明生成に時間がかかる)

- 説明画面やログ基盤の設計・実装コスト

- 説明を読む側(現場・利用者)の教育・トレーニングコスト

また、モデルの種類によっては、説明性を優先すると一部の精度指標が下がるケースもあり得ます。

そのため、現場では

- 「精度を多少犠牲にしても説明性を優先すべき領域」

- 「精度を維持しつつ、周辺に説明機能を追加するアプローチ」

を組み合わせることが現実的な選択肢になります。

5-3 XAI手法 vs 解釈可能モデル:いつどちらを選ぶべきか

XAIは、複雑なモデルに“後付け”で説明を加える手法だけではありません。

解釈可能モデル(Interpretable Models)

- 線形モデル、決定木、ルールベースモデルなど

- もともと構造がシンプルで、人間が理解しやすい

ブラックボックス+XAI手法

- 高性能なニューラルネットワークなどに、SHAPやLIMEで説明を付与

高リスク領域の中でも、

- モデルの挙動を細かく把握したい

- 監査や規制対応が重視される

といった場面では、あえて解釈可能モデルを選ぶケースもあります。

重要なのは、

「常に最新・最高性能のモデルを使う」のではなく、

用途・リスク・説明責任のレベルに応じて、モデルと説明手法を選択する

という発想です。

6 業界別のXAI活用と失敗事例(医療・金融・人事)

6-1 医療:診断支援と「過信/過小評価」のリスク

医療分野では、

- 画像診断でのGrad-CAMによる注目領域の可視化

- リスクスコアに対する主要因の一覧表示

など、XAIの活用が進みつつあります。

一方で、現場では

- AIの示すヒートマップを過度に信頼しすぎる

- 逆に、AIの示す根拠を一律に軽視してしまう

といった極端な反応が課題になることもあります。

XAIはあくまで、

「医師の判断を補助し、見落としを減らすための追加情報」

として位置づけることが重要です。

6-2 金融:融資・スコアリングの透明化と顧客コミュニケーション

金融分野では、

- 融資スコアに対する特徴量の貢献度表示

- 「この条件が変わればスコアがどう変わるか」を示す反事実的説明

などが、説明責任と顧客の納得感向上に利用されています。

成功している例では、

- 「返済履歴」「利用残高」「収入」といった要因を階層的に示し

- 「今後○ヶ月延滞がなければ、スコアが○○ポイント改善しうる」といった

行動につながる形での説明が工夫されています。

6-3 人事・採用:バイアス検証と「説明の出し方」を誤ったケース

採用領域では、過去データの偏りがそのままモデルに反映されるリスクが指摘されています。

XAIを使って特徴量重要度を確認した結果、

- 予期せぬ属性(特定の学校名・居住エリアなど)が高い重みを持っていたため、

モデルの見直しや説明方針の再設計につながった

というケースも報告されています。

一方で、

- 候補者に対して、機械的な説明文を一律送付した結果

- 「AIに差別された」「人を点数だけで見ている」と受け止められ、反発を招いた

といった事例もあります。

この領域では、

バイアス検証のためのXAI活用と候補者への説明の出し方

を切り分けて考えることが、信頼構築のうえで重要です。

下記記事ではAIエージェントについて比較しているので、参考になります。

➤2026年版|日本語環境で失敗しないAIエージェント比較──料金・精度・安全性まで“判断軸”で選ぶ | skyday

7 2026〜2030年:AIは「性能」だけでなく説明とガバナンスで選ばれる時代へ

AI が単なる研究テーマではなく、リアルなビジネスの現場でどのように使われているかは、具体的な応用事例を見ると理解しやすいです。下記記事では一例を開設しています。

➤ディズニー×OpenAI提携が示すエンタメ業界の未来 | skyday

➤生成AI×出版・教育|教材・学習支援の最新事例と日本企業の対応戦略 | skyday

7-1 製品レビューに現れ始めた「説明UX」という評価軸

これまでAIを使ったサービスの評価は、主に

- 精度

- コスト

- 処理速度

といった指標が中心でした。

しかし今後は、

- 説明が分かりやすいか

- 誤解を招きにくいか

- 問い合わせ・異議申立ての窓口が整っているか

といった「説明UX(説明体験)」も、レビューや比較記事の重要な項目になっていくと考えられます。

7-2 高リスク領域で求められるAIの条件

医療・金融・行政・教育・保険・法務などの高リスク領域では、

- 説明可能性が不十分なAI

- ガバナンスや監査体制が整っていないAI

については、導入・継続利用の判断が自然と慎重になっていくでしょう。

逆に、

- 説明可能性を確保し

- ログ・監査・トランスペアレンシーレポートの仕組みを整え

- 利用者の納得感を重視した設計がなされているAI

は、「選ばれやすいAI」として競争力を持つ時代になっていくと考えられます。

7-3 生成AI・RAG時代の「もっともらしい説明」と新しいセキュリティリスク

生成AIやRAG(検索拡張生成)を組み合わせると、

- 根拠文書やURLを提示しながら

- 非常に「もっともらしい説明」を生成する

ことが容易になります。

しかし、

- 引用されたソースが実際に存在するか

- 文脈が正しく引用されているか

- モデル内部の判断プロセスと説明がどの程度対応しているか(Faithfulness)

を確かめないと、説得力はあるが実は不正確な説明に依存してしまうリスクがあります。

このため、生成AI時代のXAIでは、

- 説明の整合性チェック

- 参照元の検証(リンク切れや文脈のずれ)

- 過度な断定表現の抑制

など、説明そのものをモニタリングする仕組みが重要になります。

8 企業が2026〜27年までに整えたいXAI導入ステップ

8-1 PoCでチェックすべき「説明品質」と関係者の納得感

PoC(概念実証)の段階では、精度指標だけでなく、次の観点も評価に含めるべきです。

- 非専門家(現場担当者)が説明を読んで、大まかな納得感を得られるか

- 説明生成にかかる時間・コストが、業務フローの中で許容できるか

- 説明を通じて、バイアスや不公平な傾向を検出・議論できるか

- 経営層・コンプライアンス・法務が説明を理解し、リスク判断に活用できるか

ここで評価すべきは、モデル単体ではなく「システム全体」です。

8-2 本番運用で必要なログ・監査・トランスペアレンシーレポート

EU AI Actや広島AIプロセスの議論でも、AIの出力だけでなく「どう説明し、どう使われたか」の記録が重視されています。

記録しておきたい情報の例:

- 利用した入力データ(個人情報保護に配慮した形式)

- AIの出力結果(スコア・ラベルなど)

- 説明生成に用いた要因・指標

- 説明を閲覧した担当者・部署・日時

- それを踏まえて行われた最終判断・対応

これらを基に、定期的な内部監査や必要に応じた第三者監査を行うことで、説明可能性は「単なる機能」から「ガバナンスの一部」へと位置づけられます。

さらに、トランスペアレンシーレポートとして、

- システムの目的・適用範囲

- 利用データの概略

- バイアス検証の方法・サマリー

- 相談窓口・異議申立て手順

などを定期的に公開することは、外部からの信頼向上にもつながります。

8-3 Human-in-the-Loopと教育・トレーニング設計

「人間が最後に判断する」という一文だけでは、Human-in-the-Loopは機能しません。

- 説明画面をどう読むか

- どの条件のときにAIの判断を採用/保留/覆すべきか

- AIの結果に疑問を持ったとき、どのルートで報告・相談するか

といった具体的なルールと、教育・トレーニングが必要です。

特に高リスク領域では、

- 導入時の初期研修

- 定期的なリフレッシュトレーニング

- 失敗事例・ヒヤリハットの共有

などを通じて、Human-in-the-Loopが形骸化しないようにすることが重要です。

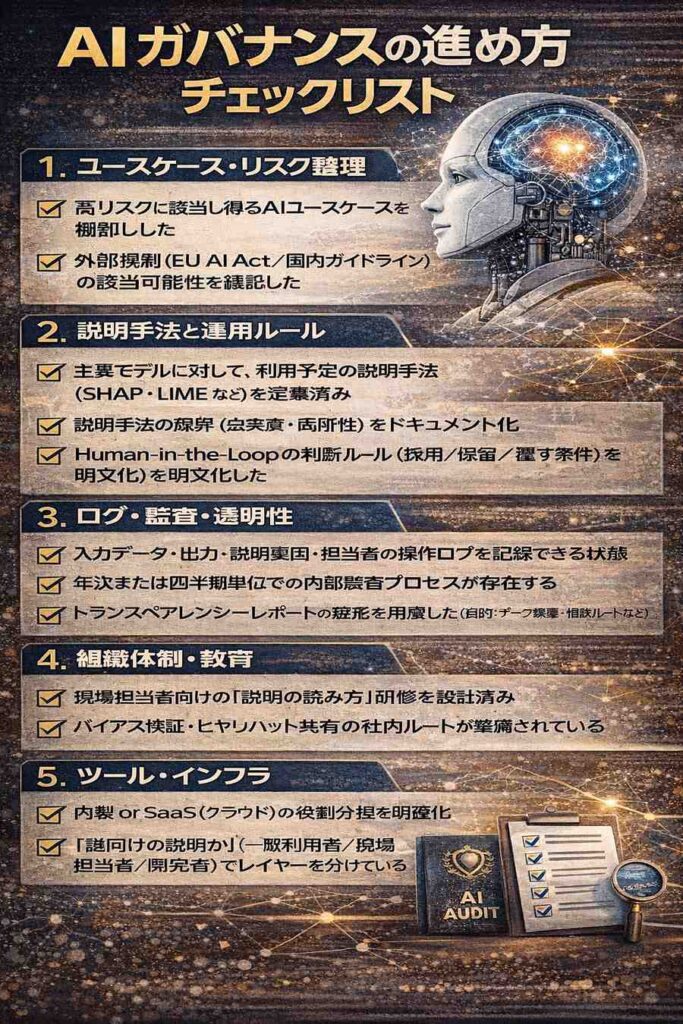

8-4 2026年までに整備したい:XAIガバナンス チェックリスト(最低限)

■ 1. ユースケース・リスク整理

- ☐ 高リスクに該当し得るAIユースケースを棚卸しした

- ☐ 外部規制(EU AI Act/国内ガイドライン)の該当可能性を確認した

■ 2. 説明手法と運用ルール

- ☐ 主要モデルに対して、利用予定の説明手法(SHAP・LIMEなど)を定義済み

- ☐ 説明手法の限界(忠実度・局所性)をドキュメント化

- ☐ Human-in-the-Loopの判断ルール(採用/保留/覆す条件)を明文化した

■ 3. ログ・監査・透明性

- ☐ 入力データ・出力・説明要因・担当者の操作ログを記録できる状態

- ☐ 年次または四半期単位での内部監査プロセスが存在する

- ☐ トランスペアレンシーレポートの雛形を用意した(目的・データ概要・相談ルートなど)

■ 4. 組織体制・教育

- ☐ 現場担当者向けの「説明の読み方」研修を設計済み

- ☐ バイアス検証・ヒヤリハット共有の社内ルートが整備されている

■ 5. ツール・インフラ

- ☐ 内製 or SaaS(クラウド)の役割分担を明確化

- ☐ 「誰向けの説明か」(一般利用者/現場担当者/開発者)でレイヤーを分けている

9 XAIツールと選び方──内製かSaaSか、誰のための説明か

9-1 代表的ツール(SHAP/LIME/What-If Tool など)の特徴

SHAPライブラリ

- Pythonなどで利用される代表的ライブラリ

- 表データのスコアリングモデルで広く使われ、

特徴量の貢献度をわかりやすく可視化できる

LIME実装

- 画像・テキスト・表などさまざまなモデルに適用可能

- 個々の事例ごとに、直感的な重みづけを示す

What-If Tool

- GUIベースで、入力を少し変えたときの出力変化をインタラクティブに確認

- バイアス検証や閾値調整のシミュレーションに向く

これらに加え、クラウドベンダーやスタートアップが提供する

ダッシュボード型の説明・監査ツールも増えています。

9-2 可視化ダッシュボードとログ基盤の設計ポイント

ツール選定の鍵は、

「その説明は、誰が見るのか?」

という視点です。

モデル開発者

- 勾配情報・特徴量寄与・データ分布など、技術的な情報が必要

ビジネス担当者・現場リーダー

- どの要因がビジネス指標に効いているか

- どのケースを再確認すべきか

一般利用者・顧客

- 行動につながる、専門用語を抑えたシンプルな説明

ダッシュボードやログ基盤を設計する際は、ステークホルダーごとに説明レイヤーを切り替えられるかを重視するとよいでしょう。

9-3 組織規模・リスクプロファイル別の「内製かSaaSか」判断軸

高度なMLチームを持つ大企業

- ライブラリを組み合わせて、自社モデルに特化した説明機能を内製

- 規制・監査要件に細かくフィットさせたい場合に有効

中小規模やAI利用が限定的な組織

- クラウドベンダーやSaaS型ツールを活用し、

まずはガイドライン準拠と基本的な説明機能を確保する

いずれにせよ、

「どこまでをツールに任せ、どこからを自社のガバナンスで補うか」

という役割分担を明確にすることが重要です。

10 生活者としてAIの判定に向き合うためのチェックリスト

下記記事では初心者向けにAIエージェントの選び方を解説しています。生活者のAIの向き合い方の参考になります。

➤2026年版|日本語環境で失敗しないAIエージェント比較──料金・精度・安全性まで“判断軸”で選ぶ | skyday

10-1 重要な判定かどうかを見極める

AIによる判定に遭遇したとき、まずは次の点を確認してみてください。

- これは生活や権利・機会に大きく影響する判断か

- 参考情報の1つなのか、ほぼ自動的に決まるのか

- 人間による最終判断の機会がどこにあるのか

融資・採用・保険・医療など、影響が大きい判断ほど、

説明や相談ルートが明示されているかを重視することが大切です。

10-2 説明の内容と、疑問点の整理の仕方

説明を受け取ったときは、次のような観点でメモをとると役立ちます。

- どのような要因が重要だと説明されているか

- 自分の状況と合わないと感じる点はどこか

- 「もしここが変われば結果も変わりうる」と示されているか

納得がいかない場合は、

「どの点が分からず、どこに疑問を感じているか」

を具体的に整理してから、追加説明や相談を求めると、対話がスムーズになります。

10-3 異議申立て・相談時に押さえておきたいポイント

- 相談・異議申立て窓口がどこかを確認する

- メールやフォームで、疑問点や状況をできるだけ具体的に伝える

- 可能であれば、人間の担当者と直接話す機会を依頼する

こうした行動は、

GDPRやEU AI Actなどで議論されている「人間による見直しを求める機会」に対応するものでもあり、生活者側からも、説明と救済プロセスを実質的なものにしていく一歩になります。

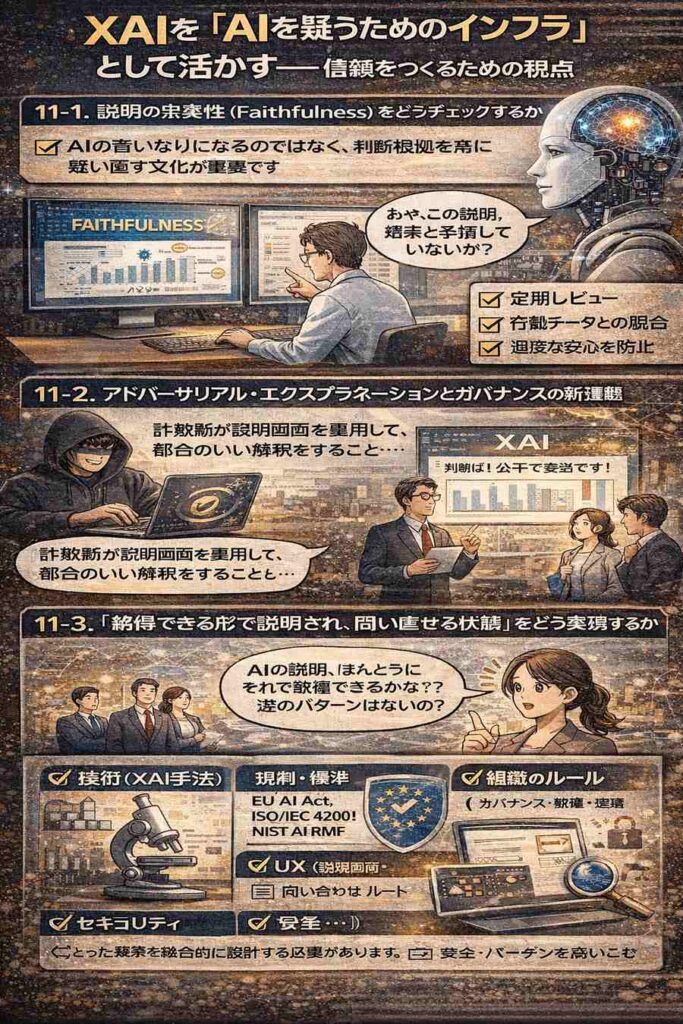

11 XAIを「AIを疑うためのインフラ」として活かす──信頼をつくるための視点

11-1 説明の忠実性(Faithfulness)をどうチェックするか

XAIは、「AIの判断を正当化するための装飾」ではなく、

「AIの判断を疑い・検証し・必要に応じて修正するための窓口」

として設計することが、長期的な信頼につながります。

そのためには、

- 説明とモデル挙動の関係(Fidelity)を定期的にチェックする

- 説明と実際の判断結果が矛盾していないかをレビューする

- 説明だけを見て、過度に安心しないためのガイドラインを整える

といった仕組みが重要です。

11-2 アドバーサリアル・エクスプラネーションとガバナンスの新課題

近年の研究では、説明そのものが攻撃対象となる、アドバーサリアル・エクスプラネーション(Adversarial Explanation)のリスクも指摘されています。

理論的には、

- 入力データや周辺情報を操作することで

- 実際には好ましくない判断であるにもかかわらず

- 説明画面だけを見ると「公平で妥当」なように見せる

といったことが起こり得るとされています。

この視点からは、

「説明が付いているから安全」ではなく、

説明の内容自体も監査・セキュリティの対象に含める

という、もう一段メタなガバナンスが求められます。

11-3 「納得できる形で説明され、問い直せる状態」をどう実現するか

最終的に、私たちが目指すべきなのは、

- AIの判断が、人間にとって理解可能な形で説明され

- 必要なときには疑問を呈し、見直しを求めることができ

- そのプロセスが透明で、公平に運用されている

という状態です。

そのためには、

- 技術(XAI手法)

- 規制・標準(EU AI Act, ISO/IEC 42001, NIST AI RMF など)

- 組織のルール(ガバナンス・教育・監査)

- UX(説明画面・問い合わせルート)

- セキュリティ(説明そのものへの攻撃も含む)

といった要素を総合的に設計する必要があります。

12 まとめ:AIを慎重に信頼するために、今からできること

AIをめぐる不安の多くは、

- 説明が利用者の目線から理解しづらい

- 説明の根拠や限界が共有されていない

- 誤りや偏りがあったときの検証・救済プロセスが見えない

といった、「納得できるかどうか」に関わる要素から生じています。

説明可能AI(XAI)は、AIを完全に透明化する魔法の技術ではありません。

むしろ、人間がAIの判断を疑い・検証し・必要に応じて修正するための、技術とガバナンスのインフラだと言えます。

生活者としては、「重要な判定かどうか」「説明と救済ルートがあるか」を確認し、必要に応じて質問や相談を行うこと。

企業としては、説明機能・ログ・監査・教育・透明性レポートを組み合わせて、信頼できるAI運用体制を整えること。

これらを通じて初めて、AIは「慎重に信頼を検討できる対象」になっていきます。

私たちが本当に求めているのは、AIを無条件に信じることではなく、

「納得できる形で説明され、必要なときには問い直せる状態」

です。

AIを未来の味方として活かせるかどうかは、これから数年のうちに、どこまで説明とガバナンスの質を高められるかにかかっています。

AIに対しての恐怖心、不信感等がある方は下記記事で不食してください。

➤2026年版|AIが怖い人のための現実ガイド — 不安・誤解・対処法を徹底解説 | skyday

※本記事の内容は、2026年1月時点で公開されている情報をもとにした一般的な解説であり、

特定の法域や事業における法的助言を行うものではありません。

実際の制度対応や契約・運用上の判断については、必ず各国法令や最新の公式情報を確認するとともに、必要に応じて専門家・法務担当への相談を行ってください。

コメント