AIが怖いのは異常ではない──まずは不安を言語化する

なぜAIは「便利」なのに、こんなにも怖いのか?

AIが急速に広まり、

「AIを使わないと時代に取り残される」

「みんなは便利に使っているのに、自分は怖くて触れない」

そんな言葉が周囲から聞こえるようになってきました。

しかし、あなたが AI に不安を感じているなら、それは異常ではありません。

むしろ 世界的な調査でも“AIへの不信・不安”が確実に増えている ことが示されています。(Edelman Trust Barometer 2024 など)

つまり、AIが怖いと感じるのは「能力不足」や「時代遅れ」ではなく、極めて自然な防衛反応 なのです。

そして本記事では、あなたのその不安を「否定する」のではなく、“あなたなりの安心できる距離感を見つける” ことを目的としています。

これは医学的診断ではない(重要な前提)

「AIアレルギー」という言葉は医学的な診断名ではありません。「心理的な比喩である」という前提をここで明記しておきます。

日本特有の文化背景も不安を後押ししている

日本は、世界的に見ても 「慎重に判断する文化」 が強く、AIのように正体の見えづらい技術に対して不安を抱きやすい傾向があります。

- 職人気質(人間の技術を重んじる文化)

- 説明の曖昧さを嫌う国民性

- 「責任の所在が不透明」だと不信感が増す特徴

- 擬人化による過度な期待と落差

この背景が、AIアレルギーを強める要因になっています。

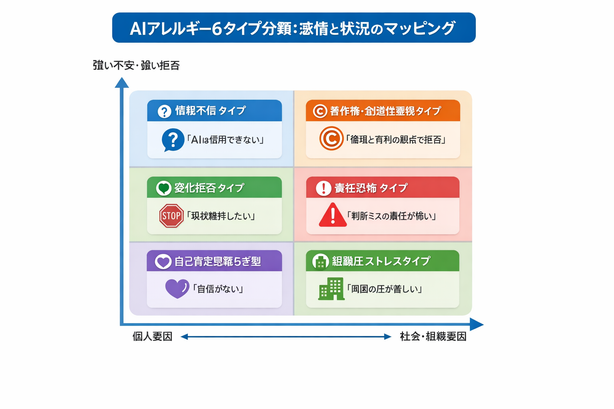

AIアレルギーの6タイプ(あなたはどれ?)

AIアレルギーは、実は「一つの原因」ではありません。

世界的な研究(アルゴリズム嫌悪/心理学研究/教育現場の調査)でも、人によってまったく違う理由でAIを避けることが分かっています。

AIが怖い、苦手、抵抗があると感じる人は少なくありません。

より広い視点で「AIが怖い」と感じる心理を解説した入門ガイドはこちら。

➤2026年版|AIが怖い人のための現実ガイド — 不安・誤解・対処法を徹底解説 | skyday

この記事では、この膨大なデータを整理し、6つのタイプ に分類しました。

あなたはどこに当てはまるでしょうか?

① 情報不信タイプ

感情:不安・疑念

キーワード:ハルシネーション/誤情報/ブラックボックス

AIの回答が本当に正しいのか分からない。

どこから情報を取っているのか説明されない。

間違っていたらどうしよう。

そんな「情報の正確性への不安」が中心にあるタイプです。

ミニ実例(2行)

- 「AIの答えがもっともらしいのに“間違っていた”とき、一気に怖くなった」

- 「出典がない文章を見ると信用できない気持ちが強くなる」

② 変化拒否タイプ

感情:不安・抵抗

キーワード:急な変化/慣れないものが怖い

職場や学校で「AI使え」と言われても、急に新しい技術に飛び込むことへのストレスが大きいタイプ。

ミニ実例(2行)

- 「作業手順が増えるのがストレスで、AIは触りたくない」

- 「“便利だから使え”と言われても、心が追いつかない」

③ 自己効力感揺らぎタイプ

感情:焦り・不安

キーワード:ついていけない/置いていかれる恐怖

周りは使えているのに自分だけ理解できていない気がする。

「できない自分」を見たくない気持ちがある。

ミニ実例(2行)

- 「同僚がAIで仕事を早く進めていて焦った」

- 「何から触ればいいか分からず、検索しては閉じてしまう」

④ 責任恐怖タイプ

感情:恐怖・警戒

キーワード:AIが間違えたら誰の責任?/判断を任せたくない

AIに任せると「自分が責任を負う」ように感じ、怖くて使えないタイプ。

ミニ実例(2行)

- 「文章作成をAIに任せると“間違っていたとき責任取れる?”と不安になる」

- 「AIを使うと、自分の判断が弱くなる気がして怖い」

⑤ 組織圧ストレスタイプ

感情:怒り・拒否・不安

キーワード:同調圧力/AI導入のプレッシャー

会社や学校の“AI推進ムード”が強く、「使わないと評価されない」ような圧を感じる。

ミニ実例(2行)

- 「研修で“AI使えないと今後厳しいですよ”と言われ、逆に怖くなった」

- 「使わないとサボっていると思われる気がする」

⑥ 著作権・創造性重視タイプ

感情:怒り・葛藤・疑念

キーワード:努力の価値/作品の学習/クリエイティブの危機

AIが学習する仕組みに倫理的な疑念があり、自分の作品が吸い上げられたり価値が薄まることに恐怖を感じる。

ミニ実例(2行)

- 「AIアートが増えて、努力して描いた作品の価値が下がる気がする」

- 「自分の文章が勝手に学習されているかもしれないと思うと不安」

実体験でわかる「AIが怖い」と感じる瞬間

AIアレルギーは、単なる理論ではありません。

多くの人が、日常で“ある瞬間”に不安を感じています。

ここでは、筆者自身が実際に見聞きした3つの実例を紹介します。

ニュースを見て恐怖を感じた友人の話

ある日、友人AからLINEが届きました。

「AIって危なくない?なんかニュースで“偽情報が広がる”って言ってたよね」

友人は、AIの誤情報(ハルシネーション)がSNSで拡散されるニュースを見て、「自分も騙されるかもしれない」という恐怖を感じたと話していました。

彼女の言葉で印象的だったのは、

「AIって何が本当で何が嘘かわからない。だから触るのも怖い」

という一言です。

実際、スタンフォード大学の「AI Index 2025」でも、AI企業を信頼できると回答した割合は前年より低下しており、“情報の正確性への疑念”が世界で加速していることが示されています。

友人の不安は、決して特殊ではありません。

職場でAIを避ける同僚の話

別の同僚Bは、AIに関する研修の後、ため息をつきながらこう言いました。

「AIって結局、ミスったら自分の責任だよね?怖くて使えないよ」

彼の部署では、「AIを使って業務効率化しよう」というトップダウンの指示があり、使わないと評価が下がるような“空気”まで生まれていました。

しかし、Bは続けました。

「AIが作った資料でミスがあったら、怒られるのはAIじゃなくて俺だから」

これは、心理学でいう 「責任恐怖」 の典型例です。

AIは便利ですが、“最終判断は人間に委ねられる構造” が、むしろ不安を増幅するという皮肉な側面があります。

自宅でAIを信用できない家族の話

母が初めてAIに料理のレシピを質問したとき、「おいしそうだけど、本当に大丈夫なの?」と、不安そうな顔をしました。

「AIに聞いて危ないレシピ出てこないの?」という疑問は、すごく自然な感情です。

人は、“命に関わる可能性のある領域” では、特にAIを信用しません。

だからこそ、医療・教育・金融などの領域がEU AI Act で 「高リスクAI」に分類される理由ともつながります。

身近な体験と国際的な議論が、実は同じ根っこを持っていることが分かります。

私自身の“AIで恥をかいた”実体験

筆者も、AIを使い始めた頃に、ちょっとしたミスで恥をかいたことがあります。

それは、AIに文章を要約させて提出したときのことでした。

あとで読み返すと、「存在しない事例」をもっともらしく書いていたのです(=典型的なハルシネーション)。

上司に指摘され、顔から火が出るような気持ちになりました。

以来、

「AIの文章は必ず自分で裏取りしないと怖い」

という感情が自分の中に根づきました。

この感情は、ペンシルベニア大学の Algorithm Aversion(アルゴリズム嫌悪) 研究が示す通り、人間が“AIのミスに極端に厳しくなる” 心理そのものです。

こうした経験を経て、AIに対する不信感や怖さは、「非合理」ではなく「経験に基づいた正当な反応」だと理解できるようになりました。

AIが怖いと感じる理由(心理学 × 技術)

AIへの不安の背景には、社会全体で「どうAIを安全に扱うか」という議論も関係しています。

EU・米国・日本などのAI規制を体系的にまとめた記事はこちら。

➤【決定版】2026年AI規制大全|EU・米国・日本・中国を完全比較!GPAI・ISO42001まで最速で理解する | skyday

AIアレルギーの背景には、心理学・社会構造・技術の挙動など、複数の要因が重なっています。

ここでは一般向けにやさしく整理して解説します。

現状維持バイアスと自己効力感の揺らぎ

心理学には「現状維持バイアス」という言葉があります。

- 今のやり方の方が安全に感じる

- 変わるよりも「変わらない」方が安心する

AIが登場すると、「今のやり方ではダメなのでは?」という圧力が生まれ、それが心理的ストレスになります。

さらにAIは「自分より賢いかもしれない」という感情を呼び起こすため、自己効力感(自分はできるという感覚)が揺らぎやすい のです。

AIの“もっともらしい嘘(ハルシネーション)”の仕組み

AIは、統計的に最も“それっぽい言葉”を並べる技術です。

そのため、自信満々に間違えることがあります。

これを「ハルシネーション」と呼びます。

各種研究では、ユーザーがハルシネーションに遭遇するとAIへの信頼が一気に低下し、その後の利用意欲も落ちることが確認されています。

つまり、「AIは間違わないはず」という誤解が裏切られた瞬間に、強い拒否感が生まれます。

これは、人間の自然な心理反応です。

誤認識や誤作動はAIへの不安を強める代表的な要因です。

誤認識や誤作動に関する現場AI(鉄道AI)が抱える“誤検知・責任問題”を深掘りした記事はこちら。

➤鉄道AIは本当に私たちの命を守れるのか?─「誤検知」「責任」「職人技」の不安に、最新データで答える | skyday

ブラックボックス化が生む不信感

AIは「なぜその答えを出したか」が見えません。

説明できないものに人間は不安を覚えます。

世界的な調査でも、「AIは透明性がない」「データ保護が不十分」という不信が増えており、これがAIアレルギーの大きな要因になっています。

AIを信頼できない背景には、「仕組みが見えない」というブラックボックス問題があります。

AIがどう“説明できる”のかを詳しく解説したXAI(説明可能AI)ガイドはこちら。

➤説明可能AI(XAI)とは? なぜ人はAIを素直に信じられないのか | skyday

学習データの倫理問題(著作権・非同意データ)

最近の訴訟(Authors Guild v. OpenAI、Andersen v. Stability AI など)は、AIが学習するデータに「無断利用」が含まれている可能性を示しています。

クリエイターがAIに拒否感を持つのは、自分の作品が勝手に学習されているかもしれないという不信が背景にあるからです。

これは単なる感情論ではなく、法的にも議論されている正当な不安です。

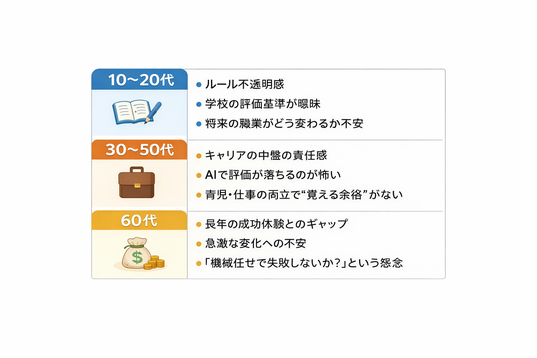

年代別に違うAIアレルギーの背景

AIアレルギーは年代によっても異なります。

ただし、偏見にならないよう「〜という傾向がある」の形で記述します。

10〜20代:ルール不透明感と将来不安

教育現場の調査では、教員自身が「AIをどう評価すべきか分からない」と不安を抱えており、それが学生にも伝播している可能性があります。

そのため若者は、「AIを使っていいのか悪いのか分からない」という ルール不透明感 に不安を抱える傾向があります。

30〜50代:キャリアと責任の板挟み

この世代は、職場のAI推進と自分のスキル不足の間で板挟みになりやすい傾向があります。

自己効力感が揺らぎ、「自分だけ置いていかれるのでは」という焦燥感がAIアレルギーを強めます。

60代:長年の成功体験とのギャップ

この世代は、長年の経験で築いてきた“自分のやり方”の価値がAIによって揺らぐことへの不安を抱きやすい傾向があります。

これは決して否定ではなく、人生で積み上げてきた大切な成功体験を守ろうとする自然な反応です。

AIとの心理的距離を最適化するステップ

AIは「克服する対象」ではありません。

むしろ、“自分にとってちょうどいい距離” を探す方が自然で、確実に前へ進めます。

以下では、読者の負担が少ない順に「距離調整のステップ」を紹介します。

ステップ1:AIにできないこと(人間だけの領域)を再確認する

AIアレルギーを和らげる上で最初に大切なのは、「AIは何でもできるわけではない」という現実を知ることです。

AIは得意不得意の差がとても大きい技術です。

AIが苦手なこと

- 価値判断(何が正しい/正しくない)

- 倫理・責任の決定

- 新しい概念の創造(完全な“ゼロから”は難しい)

- 文脈の深すぎる解釈

- 人間の人生経験から生まれる共感

逆に、人間だけが持つ領域は確かに存在しており、そこはAIがいくら進化しても侵食できません。

そのことを理解すると、AIに対する“存在論的な恐怖”(自分が不要になるのでは…という不安)が

少しずつ和らぎます。

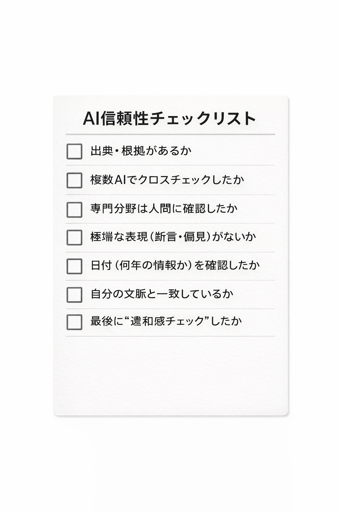

●ステップ2:AI信頼性チェックリスト(保存版)

読者が「怖い」と感じる最大の理由は、“信頼できるかどうか分からない” という状態にあります。

そこで、明日から使える 「AIの信頼性を確かめるチェックリスト」 を作成しました。

スマホのメモにコピペして使えるよう“文章だけで完結”させています。

AI信頼性チェックリスト(7項目)

- 出力の根拠が示されているか?(ソース・引用・データ)

- 複数のAIでクロスチェックしたか?

- 専門領域(医療・法律・金融)では人間専門家に確認したか?

- 極端な断言・偏見・攻撃的表現が出ていないか?

- 日付情報(何年のデータか)を確認したか?

- 自分の文脈(状況・目的)に合っているか?

- 最後に自分の常識と照らし合わせて違和感がないか?

このチェックリストの役割

- 「AIを盲信するリスク」を回避

- 「AIの誤答に振り回される不安」を軽減

- 「AIを信用するポイント」が明文化され安心感が増す

AIを使う=危険ではなく、“正しく距離を取れば、安全に使える”という認識に変わり始めます。

ステップ3:失敗しても安全な“AI練習場”を作る

AIをいきなり仕事で使うのは、怖くて当然です。

まずは、「失敗しても誰にも迷惑がかからない場所」で練習するのが最適です。

◎ 練習におすすめの題材

- 旅行プランを作ってもらう

- 今日の献立を考えてもらう

- 部屋の片付けの手順を相談する

- 趣味の情報をまとめてもらう

- スマホで撮った写真の説明を書いてもらう

こうした「生活の軽いタスク」なら、誤っても誰も困りません。

慣れたら「自分の仕事の一部だけ」を任せる

仕事で使う場合は、以下の順番が安全です。

- 情報整理(メモ→要約)

- アイデア出し

- メールの下書き

- 企画書の補助

- 最終判断は必ず人間が行う

この順番は、AIの誤答リスクが少ない順にもなっています。

AIと距離を置くという選択肢もある

AIの活用を否定しない一方で、「使わない自由」 を守るのも非常に大切です。

検索意図の調査でも、「AIを使わない選択肢を認めて欲しい」という声が多く見られます。

アナログの価値の再評価

AIがどれだけ進化しても、アナログが持つ価値はなくなりません。

- 手書きメモの深い思考

- 人と直接話すことで生まれる感情

- 体験から生まれる判断力

- “時間をかける”ことそのものの価値

AIアレルギーは、こうした“人間らしい価値”を守ろうとする感情でもあります。

「知らないまま」でいるリスクを丁寧に説明する

ただし、AIから完全に目を背けると、情報格差が生まれる可能性があります。

ここで重要なのは、AIを「使う/使わない」ではなく、“AIを理解しておく” という中間の選択肢です。

何ができて、何ができないかだけでも知っておくと、時代の変化に不安を抱く必要がなくなります。

AI時代に自分を守るための戦略

最後に、AIアレルギーを抱える人が「安心してAI時代を生きる」ための思考法をまとめます。

心理的安全性を確保する思考法

AIと向き合うときに重要なのは、“不安を正常化すること” です。

- 「AIが怖い」と思うのは普通

- 「使い方が分からない」のも普通

- 「失敗したら嫌だ」という感情も普通

この“正常化”によって、脳はストレスから少し解放されます。

AIと共存する未来に必要なマインド

AIはもう社会のインフラです。

しかし、私たちの人生を奪うものではありません。

必要なのは、「AIに頼る」のではなく“AIを使いこなす自分を信頼する”という姿勢です。

そのために必要なのは、

- 情報を読み解く力

- 適切に距離をとる力

- 本質を見抜く力

- AIに責任を丸投げしない力

これらはすべて、AIではなく人間だけが持てる能力です。

まとめ:あなたの不安は“正しい”

AIアレルギーは、弱さではありません。

むしろ、人間が持つ「防衛本能」であり

AI社会を生きるうえで重要なセンサーです。

ただし、その不安を言語化し、距離を調整し、自分のペースで向き合っていくことで、AIはあなたの人生の脅威ではなく「使うかどうかを自分で選べる道具」になります。

この記事で、あなたが“安心してAI時代を歩くための小さな支え”になれたら幸いです。

実際にAIを使ってみると、不安が解消されるケースも少なくありません。

筆者が実際にAIツールを使ってみた体験レポートはこちら。

➤「AIが怖い」人へ|初めてChatGPTを使って分かったこと3つ【実体験】 | skyday

付録:参考文献・出典リスト

公式調査・政府系資料

● 内閣府「AIに関する世論調査」

● 総務省「情報通信白書 2024」

● IPA(情報処理推進機構)「AI原則ガイドライン」

国際世論・信頼調査

● Edelman Trust Barometer(2024–2025)

● Stanford HAI “AI Index 2025 – Public Opinion”

● Ipsos “Public Trust in AI 2024”

研究論文・学術データ

● Dietvorst, B.J. et al. “Algorithm Aversion”

● ハルシネーションと信頼低下に関する実験(diva portal / Harvard misinfo review)

● Generative AI と教師の態度に関する研究(Frontiers in Psychology)

法律・訴訟

● Authors Guild v. OpenAI(作家団体の訴訟)

● Andersen v. Stability AI(アーティスト集団訴訟)

● EU AI Act(2024採択)

文化・倫理研究

● “The Development of AI Ethics in Japan”(日本のAI倫理文化)

● クロスカルチャー研究(AIアート受容性)

付録2:この記事について

本記事が大切にしていること

- 医学的診断ではなく「心理的な比喩」としてAIアレルギーを扱っている

- 個人の不安を「劣っている」と捉えない

- 専門家の調査・論文・国際データをもとに構成

- 筆者自身や周囲の実体験を交え、人間の視点から執筆

- AIを「使う/使わない」の両方の選択肢を尊重

- 読者の心理的安全性と尊厳を第一に考えている

■ 情報の更新について

AIと法制度は変化が早いため、本記事は2026年1月時点の最新情報 をもとに執筆しています。

重要な法改正・調査結果が発表された際には、随時更新します。

コメント